2025年2月24日——由360与北京大学联合研发的中等量级推理模型Tiny-R1-32B-Preview正式亮相,仅以5%参数,逼近Deepseek-R1-671B的性能。

核心突破:小模型,大能量

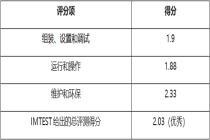

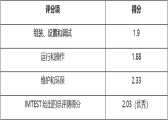

数学领域:以78.1分(AIME 2024评测)逼近原版R1模型(79.8分),远超Deepseek-R1-Distill-Llama-70B(70.0分);

综合性能:在编程(LiveCodeBench 61.6分)、科学(GPQA-Diamond 65.0分)领域全面开源70B模型Deepseek-R1-Distill-Llama-70B;

效率跃迁:仅需5%参数量,性能达原版R1的95%以上,推理成本大幅降低。

技术革新:领域专精+模型融合

研究团队使用「分治-融合」策略:

基于DeepSeek-R1生成海量领域数据,分别训练数学、编程、科学三大垂直模型;

通过Arcee团队Mergekit工具智能融合,突破单一模型性能上限,实现多任务均衡优化。

开源承诺:推动技术普惠

即将公开完整技术报告、训练代码及部分数据集;

践行开源精神,助力AI社区共筑高效推理新生态。

研发团队表示:「Tiny-R1-32B-Preview是蒸馏技术的里程碑,未来将持续探索更轻量、更强大的通用模型,推动AI技术普惠化进程。」

360 团队: Lin Sun, Guangxiang Zhao, Xiaoqi Jian, Weihong Lin, Yongfu Zhu, Change Jia, Linglin Zhang, Jinzhu Wu, Sai-er Hu, Xiangzheng Zhang

北大团队: Yuhan Wu, Zihan Jiang, Wenrui Liu, Junting Zhou, Bin Cui, Tong Yang

免责声明:本文仅代表作者个人观点,与每日科技网无关。其原创性以及文中陈述文字和内容未经本站证实,对本文以及其中全部或者部分内容、文字的真实性、完整性、及时性本站不作任何保证或承诺,请读者仅作参考,并请自行核实相关内容。

本网站有部分内容均转载自其它媒体,转载目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责,若因作品内容、知识产权、版权和其他问题,请及时提供相关证明等材料并与我们联系,本网站将在规定时间内给予删除等相关处理.